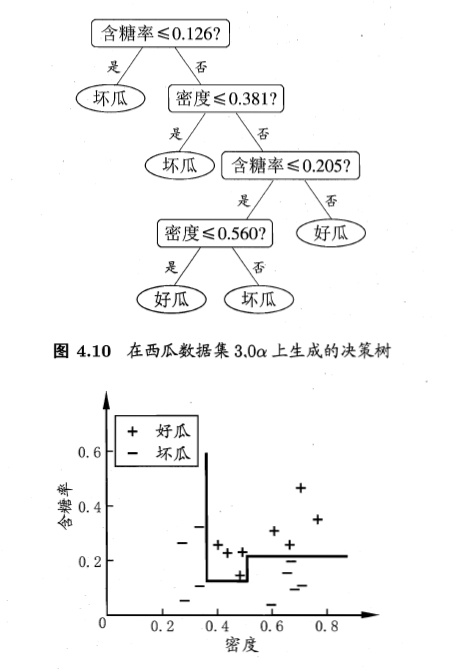

前面讲到的都是单变量决策树,即每次只选取一个属性进行划分

其实就是确定分类边界,且单变量决策树的决策边界都是平行于坐标轴,如下图

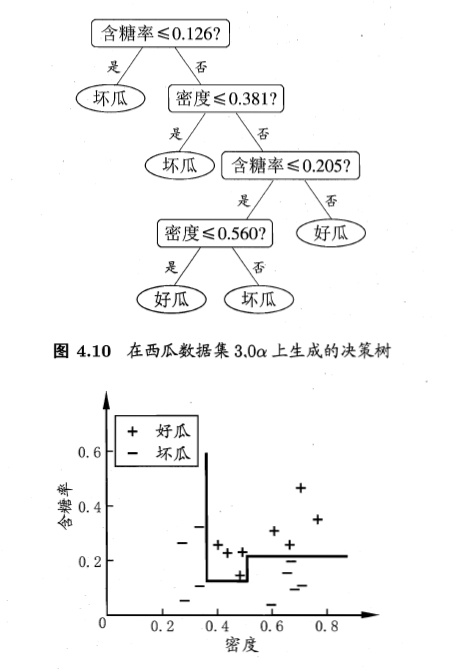

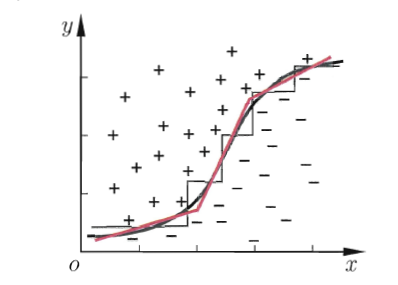

有些时候我们希望用斜线甚至曲线去进行划分以得到更好的泛化能力:

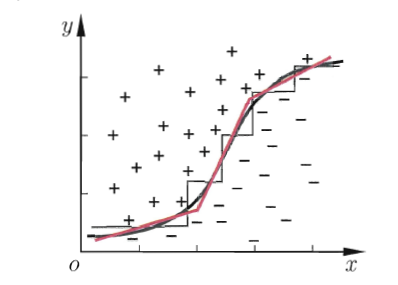

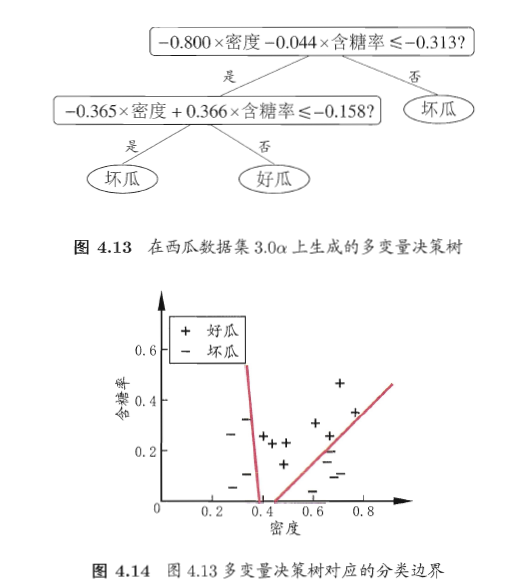

这种“斜划分”的方式就是多变量决策树,划分依据不再是单个属性,而是一个形如$\sum\limits_{i=1}^dw_ia_i=t$的线性分类器,${w_i}$和t是需要学习的参数

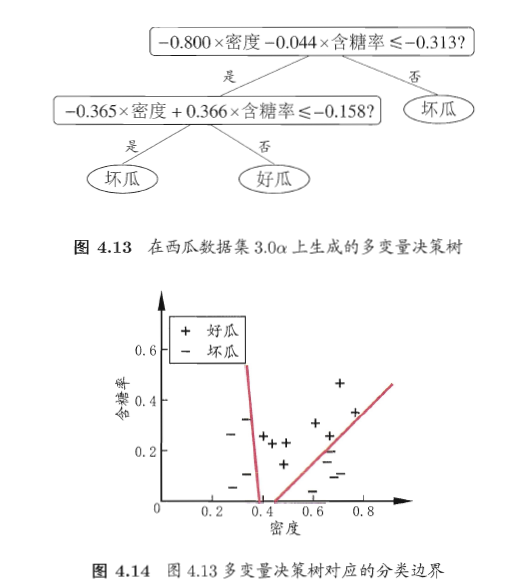

前面讲到的都是单变量决策树,即每次只选取一个属性进行划分

其实就是确定分类边界,且单变量决策树的决策边界都是平行于坐标轴,如下图

有些时候我们希望用斜线甚至曲线去进行划分以得到更好的泛化能力:

这种“斜划分”的方式就是多变量决策树,划分依据不再是单个属性,而是一个形如$\sum\limits_{i=1}^dw_ia_i=t$的线性分类器,${w_i}$和t是需要学习的参数